AI-minnekrisen: Derfor er HBM blitt en geopolitisk råvare

Bak enhver stor språkmodell sitter et stykke maskinvare som verden ikke klarer å produsere raskt nok: High Bandwidth Memory.

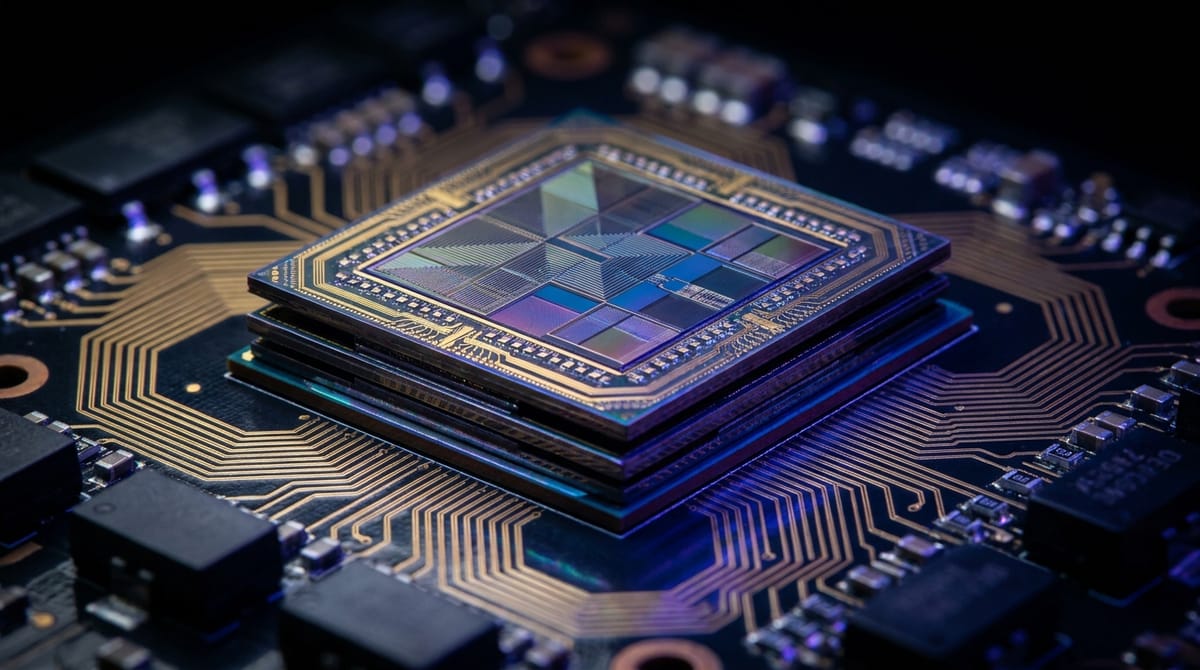

HBM – flaskehalsen ingen snakker om

HBM er den kritiske komponenten i moderne AI-akseleratorer. Det er ikke prosessorkraft som begrenser AI-veksten – det er minnet som flyttes til og fra prosessoren. Produksjonen domineres av tre aktører: SK Hynix, Samsung og Micron – alle med komplekse forsyningskjeder og sårbare for geopolitiske forstyrrelser i råvaretilgangen. Å sette opp nye produksjonsanlegg tar opptil fem år. Etterspørselen vokser i måneder.

Tre krefter som presser minnebruken opp

Problemet forverres av at behovet for minne vokser fra flere hold samtidig:

Autonome AI-agenter bruker millioner av tokens per interaksjon for å planlegge og utføre oppgaver – langt mer enn en vanlig chatsamtale. Moderne KV-cache krever store minnereserver for å holde konteksten i lange sesjoner. Og jo mer minne som trengs, jo høyere blir kostnadene for alle AI-tjenester – fra API-priser til strøm.

Programvare som svar på et maskinvareproblem

Det er her teknologier som Google TurboQuant kommer inn. Når produksjonskapasiteten ikke kan skaleres raskt nok, blir radikal komprimering og kvantisering den eneste realistiske kortsiktige løsningen – gjøre mer med det minnet som faktisk finnes.

Det er ikke en perfekt løsning. Men det er den eneste som kan implementeres uten å vente fem år.

Et sammensatt problem

AI-minnekrisen er ikke bare teknisk – den er økonomisk og geopolitisk. Veien ut krever begge deler: økt produksjonskapasitet på lang sikt, og smartere programvare mens verden venter på at fabrikkanleggene kommer i drift.

Ressurser: Google Research – TurboQuant · SEMI – halvlederindustrien