Articulate Anything: Slik lærer roboter å åpne en skuff

Roboter trener ikke på den virkelige verden – de trener i simuleringer. Men hvem lager alle de digitale objektene de øver på? Nå kan AI gjøre det automatisk.

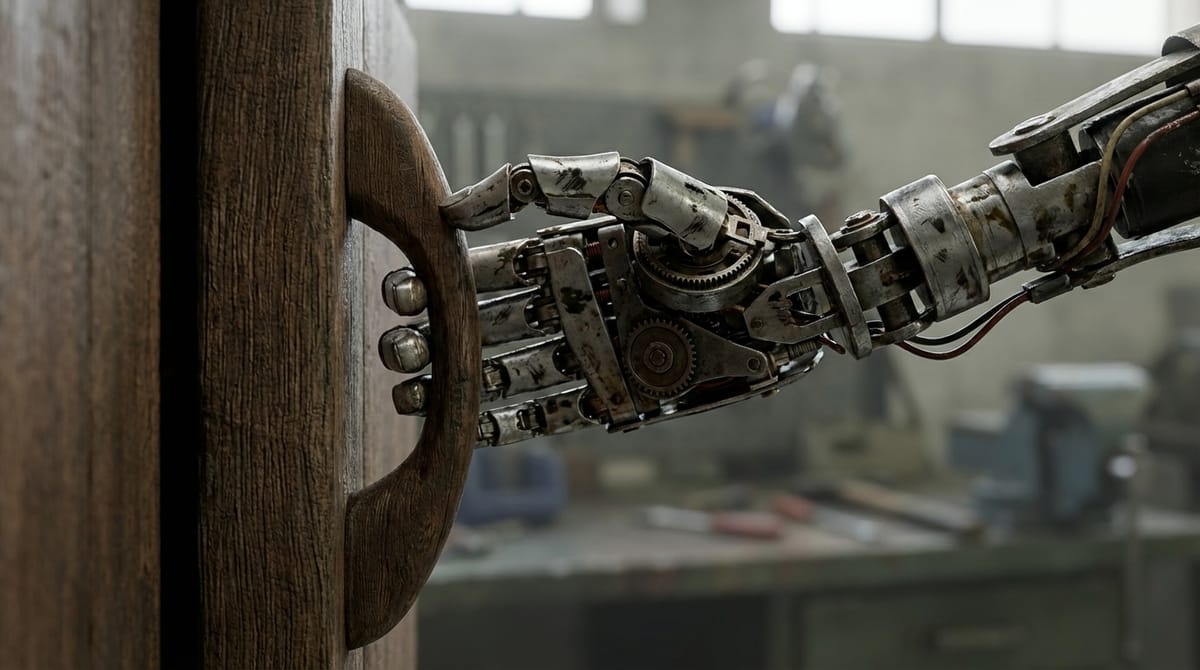

Tenk deg at du skal lære en robot å åpne et skap. Før roboten i det hele tatt kan øve, trenger du en digital kopi av skapet – komplett med hengsler, dybde og fysiske egenskaper. Det har tradisjonelt tatt timer å modellere manuelt.

Articulate Anything gjør det på sekunder.

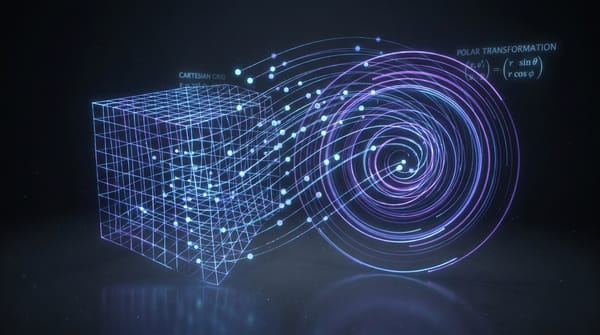

Fra bilde til bevegelig 3D-modell

Verktøyet tar inn tekst, bilder eller video – og genererer automatisk en ferdig URDF-fil. URDF er standarden for robotsimuleringer: den forteller simulatoren nøyaktig hvordan et objekt beveger seg, hva det veier, og hvordan leddene er koblet.

Slik fungerer det under panseret:

- En Vision-Language Model (VLM) analyserer inndata og identifiserer bevegelige deler

- Systemet genererer kode for 3D-modellen

- Koden testes automatisk i en simulator

- Feil oppdages og korrigeres autonomt – uten menneskelig innblanding

Det siste punktet er det viktigste. Articulate Anything er ikke bare et generativt verktøy. Det er en agentisk loop som itererer til resultatet faktisk fungerer.

Treningsdata for den virkelige verden

Problemet med robottrening er klassisk: roboter trenger millioner av treningseksempler, men å samle dem i virkeligheten er kostbart og farlig. Løsningen er sim-to-real – tren i simuleringen, overfør til den fysiske roboten.

Men da trenger du gode simuleringer. Det er her Articulate Anything blir strategisk viktig:

- Du kan bygge store biblioteker av virtuelle objekter raskt

- Objektene har korrekte fysiske egenskaper fra starten

- Roboter kan øve på kantete kantinetraller, gamle skap og ukjente verktøy – ikke bare perfekte CAD-modeller

Det betyr at fremtidens humanoide roboter kan trenes på et langt mer variert og realistisk datasett enn hva som har vært mulig før.

Trender å følge

Sim-to-real akselererer

Boston Dynamics, Unitree og Figure AI konkurrerer alle om å bygge roboter som fungerer i ustrukturerte omgivelser – kjøkken, fabrikker, sykehjem. Den som raskest kan generere og trene på realistiske simuleringer, vinner markedet. Verktøy som Articulate Anything er ikke perifere – de er kjerneteknologi.

Komplementær teknologi

Articulate Anything inngår i et voksende økosystem for 3D-generering. PartGen løser et beslektet problem (generering av 3D-deler fra bilder), mens verktøy som Genesis og Isaac Sim gir simuleringsplattformer. Det interessante er at disse verktøyene forsterker hverandre – bedre 3D-generering gir bedre simuleringer gir bedre roboter.

AI som sin egen dataingeniør

Det største skiftet er kanskje dette: AI-systemer begynner å produsere sine egne treningsdata. Articulate Anything er et tidlig eksempel. Kombinert med syntedataverktøy og LLM-drevne simuleringer peker dette mot en fremtid der den manuelle datafabrikasjonen forsvinner nesten helt.

Hvorfor dette er viktig nå

Robotikk har lenge vært en sektor der fremdriften er saktere enn hype-kurven. Det som endrer seg nå er ikke hardware – det er dataflyten. Å generere, annotere og validere treningsdata har vært en flaskehals. Articulate Anything er ett av flere verktøy som begynner å løse dette automatisk.

Hvis sim-to-real virkelig skal skalere, trenger feltet tusenvis av artikulerte objekter – ikke hundrevis. Det er der automatisering som dette henter sin strategiske verdi.

Oppsummering

Articulate Anything konverterer tekst, bilder og video til ferdige, fysisk korrekte 3D-modeller for robotsimulatorer. En selvkorrigerende agentloop sørger for at outputen faktisk fungerer. Resultatet er raskere og billigere produksjon av treningsdata – noe som kan akselerere hele robotikkfeltet.