DeepSeek V3: kraftig AI til lav kostnad

DeepSeek-V3 viser at avansert AI ikke lenger krever enorme budsjetter.

Modellen leverer høy ytelse, samtidig som kostnadene holdes betydelig lavere enn hos mange konkurrenter.

Hva er DeepSeek-V3?

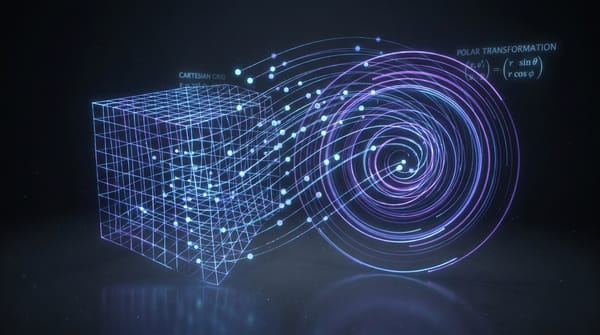

DeepSeek-V3 er en åpen modell basert på en Mixture-of-Experts (MoE)-arkitektur.

Dette betyr at:

- modellen har svært høy total kapasitet

- kun deler av modellen brukes per forespørsel

- ytelse og effektivitet balanseres bedre

Hvordan fungerer teknologien?

DeepSeek-V3 har totalt 671 milliarder parametere, men aktiverer kun en mindre del per token.

Fordeler:

- raskere respons

- lavere beregningskostnad

- bedre skalerbarhet

Dette gjør modellen mer praktisk i reelle systemer.

Viktige egenskaper

Effektiv trening

Modellen er utviklet med fokus på kostnadseffektivitet.

- betydelig lavere treningskostnad enn mange lukkede modeller

- optimalisert ressursbruk

Sterk ytelse i utvalgte tester

DeepSeek-V3 gjør det godt innen:

- programmering

- matematikk

- tekniske oppgaver

Den konkurrerer med flere kommersielle modeller i disse områdene.

Åpen tilgjengelighet

En viktig forskjell er at modellen er tilgjengelig med åpne vekter.

Dette gjør det mulig å:

- kjøre modellen lokalt

- tilpasse den til egne behov

- bygge egne systemer

Lavere kostnader

API-bruk og drift kan være betydelig billigere sammenlignet med tilsvarende løsninger.

Dette senker terskelen for:

- startups

- utviklere

- små team

Hvorfor dette er viktig

DeepSeek-V3 peker på en tydelig trend:

- høy ytelse blir mer tilgjengelig

- kostnader reduseres

- open source får større betydning

Dette øker konkurransen i AI-markedet.

Hva betyr dette fremover?

Vi vil sannsynligvis se:

- flere effektive modeller

- økt fokus på kostnad

- raskere innovasjon i open source-miljøet

Dette kan endre balansen mellom åpne og lukkede løsninger.

Oppsummering

DeepSeek-V3 viser at:

- avansert AI kan bygges mer effektivt

- open source-modeller kan konkurrere på ytelse

- kostnadsnivået i AI er i ferd med å falle

Dette gjør kraftig AI mer tilgjengelig for flere.