Finjuster din egen AI lokalt – slik tar du full kontroll

Vil du ta kontroll over din egen AI?

Det er nå fullt mulig å finjustere små og effektive språkmodeller direkte på din egen maskin – uten å være avhengig av dyre skytjenester.

Et godt eksempel er Gemma 3 270M, en kompakt modell som er perfekt for spesifikke oppgaver og lokal kjøring.

Hvorfor kjøre dette lokalt?

Den største fordelen er personvern.

Når du trener modeller lokalt:

- dataene dine forblir på din egen maskin

- du unngår å sende sensitiv informasjon til eksterne tjenester

- du har full kontroll over hele prosessen

Dette er spesielt viktig for:

- bedrifter med konfidensiell data

- utviklere som bygger egne løsninger

- alle som ønsker en mer privacy-first tilnærming

Verktøy du kan bruke

Du har flere alternativer, avhengig av maskinvaren din:

- NVIDIA DGX Spark

Kraftig lokal maskinvare laget for AI-utvikling - Google Colab

Et godt alternativ hvis du ikke har nok kraft lokalt

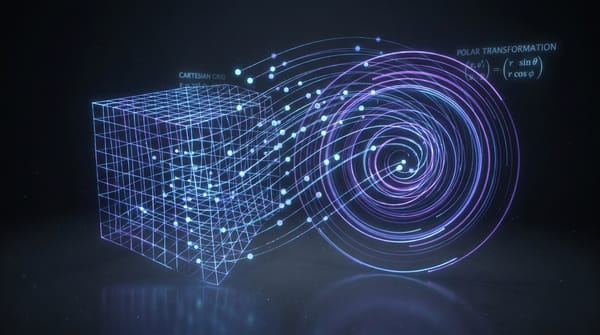

Hvordan fungerer finjustering?

Gemma 3 270M er en liten modell (under 1 milliard parametere).

Det gjør den rask og effektiv for spesifikke oppgaver.

Ved hjelp av teknikker som LoRA (Low-Rank Adaptation) kan du:

- tilpasse modellen til egne datasett

- lære den spesifikke oppgaver

- gjøre dette på kort tid, ofte på minutter

Typiske bruksområder:

- strukturering av tekst

- dataekstraksjon

- spesialiserte assistenter

Hvorfor dette er interessant nå

Tidligere krevde AI-trening store datasentre og høy kostnad.

Nå:

- små modeller er kraftige nok

- verktøyene er tilgjengelige

- terskelen er mye lavere

Det betyr at flere kan bygge egne løsninger – helt lokalt.

Oppsummering

Lokal finjustering gir deg:

- full kontroll

- bedre personvern

- lavere kostnader

For mange er dette starten på å gå fra bruker av AI til å faktisk bygge egne AI-verktøy.