Gemma 4-modellene: Én for Hver Maskin

Fra mobiltelefon til kraftig arbeidsstasjon – Gemma 4-serien har en variant for deg uansett hardware.

Ikke én modell, men en hel familie

Google DeepMind har sluppet Gemma 4 i flere størrelser samtidig. Du velger modellen som passer maskinen din, ikke omvendt.

Oversikt over variantene

- e2b – ultrakompakt, kjører direkte på mobiltelefoner og nettbrett

- e4b (MoE) – aktiverer bare en brøkdel av parameterne per oppgave, effektiv og rask

- 26b – solid mellomklasse for laptop og lokal server

- 31b – kraftpakken, for krevende oppgaver på arbeidsstasjon eller server

MoE er det virkelig interessante

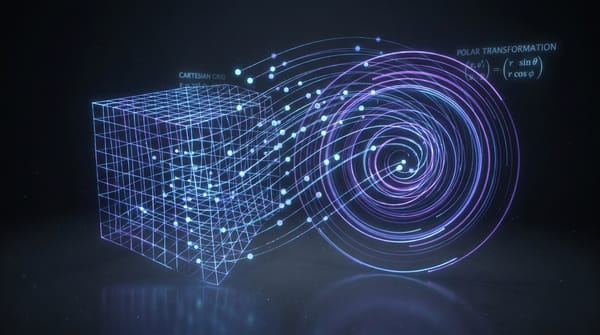

Mixture of Experts er ikke bare et teknisk triks – det er en arkitektonisk revolusjon. Modellen har mange spesialiserte "eksperter" internt, men aktiverer bare de relevante for hver enkelt oppgave.

Hva det betyr i praksis

- Langt lavere maskinvarekrav enn full modellstørrelse skulle tilsi

- Raskere inferens

- Kvalitet som konkurrerer med tunge dense-modeller

Multimodal fra bunnen av

Det som virkelig skiller Gemma 4 fra tidligere generasjoner er bredden i kapabiliteter. Alle varianter støtter:

- Vision – forstår og analyserer bilder

- Audio – håndterer lydinnput

- Tools – kan bruke eksterne verktøy og APIer

- Thinking – innebygd resonnering for komplekse oppgaver

Kontekstvinduer som imponerer

Alle varianter støtter kontekstvinduer på mellom 128K og 256K tokens. Selv den kompakte e2b kan håndtere lange dokumenter og komplekse instruksjoner i én omgang.

Finn din variant

| Modell | Bruksområde | Hardware |

|---|---|---|

| e2b | Mobil, rask inferens | Telefon, nettbrett |

| e4b (MoE) | Balanse ytelse/effektivitet | Laptop, lokal server |

| 26b | Allsidig daglig bruk | Moderne GPU |

| 31b | Maksimal nøyaktighet | Kraftig GPU/server |

Hvorfor dette er viktig

Gemma 4-familien viser at Google DeepMind ikke bare bygger modeller for forskningsmiljøer. De bygger for alle – fra hobbyutvikleren med en MacBook til bedriften med dedikert inferensserver.

Med åpen Apache 2.0-lisens og denne bredden i størrelser er det nå vanskeligere enn noensinne å argumentere for at lokal AI er for komplisert eller dyrt.

Oppsummering

Bredden i Gemma 4-serien er ikke tilfeldig. Det er en bevisst strategi for å gjøre avansert AI tilgjengelig uansett maskinvare og bruksområde. Velg størrelsen som passer deg – og kjør lokalt.