GPT-5.5 i helsevesenet: Når generell AI møter kliniske krav

Ferske tester av GPT-5.5 avdekker en viktig sannhet om dagens AI-landskap: imponerende allmennytte er ikke det samme som medisinsk presisjon.

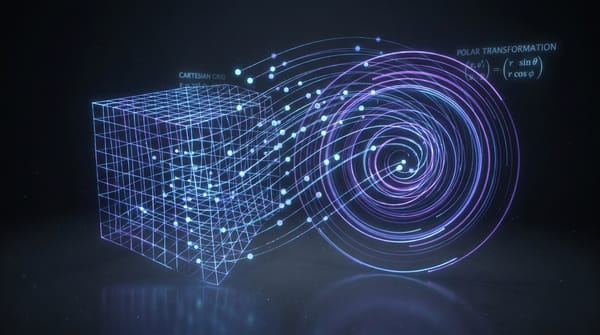

Bildediagnostikk avslører gapet

I tester på komplekse CT-bilder viser GPT-5.5 tydelige begrensninger. Modellen klarer å identifisere åpenbare mønstre, men nøyaktigheten faller markant i subtile tilfeller. Et konkret eksempel er identifisering av visse hjernesvulster, der modellen oppnådde kun 17 % nøyaktighet – langt under det som kreves i klinisk praksis.

Dette er ikke et tegn på at GPT-5.5 er en dårlig modell. Det er et tegn på at den er bygget for noe annet.

Spesialisering er nøkkelen

For at AI skal ha en reell plass i helsevesenet, holder det ikke med brede treningsdata og generell resonneringsevne. Det kreves:

- Trening på medisinske datasett med dokumentert kvalitet og sporbarhet

- Dypere domenekunnskap innen spesifikke kliniske felt

- Streng validering mot eksisterende diagnostiske standarder

OpenAI og andre store modellaktører leverer kraftige verktøy – men "kraftig" og "klinisk egnet" er to svært ulike ting.

Menneskelig kontroll er fortsatt avgjørende

GPT-5.5 er et fremragende verktøy for generelle oppgaver, men i situasjoner der liv og helse står på spill, er tett menneskelig kontroll ikke et valg – det er et krav.

Veien videre handler ikke om å vente på at generelle modeller blir gode nok. Den handler om å bygge spesialiserte systemer som er trent, testet og godkjent for medisinsk bruk.

Ressurser: OpenAI · GPT-5.5 – generell ytelse