Ternary Bonsai: kraftig AI på 1,75 GB

En 8-milliarders parametersmodell som kjører på en iPhone og

bruker under 2 GB RAM. Det er ikke en kompromissmodell –

den slår de fleste fullstørrelsesmodeller i sin klasse.

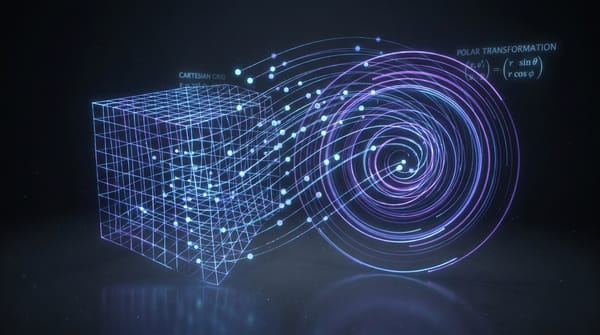

Hva er 1,58-bit?

Tradisjonelle modeller lagrer hver vekt med 16 eller 32 bits.

Ternary Bonsai bruker bare tre mulige verdier per vekt:

{-1, 0, +1}. Matematisk kreves det log₂(3) ≈ 1,58 bits

for å representere tre tilstander – derav navnet.

Resultatet er en kompresjon på 9x sammenlignet med standard

16-bits modeller, bygget inn i selve arkitekturen fra starten –

ikke lagt på som et etterbehandlingssteg.

Tallene som imponerer

Minnekravene er nesten utrolig lave for det du får:

- 8B – 1,75 GB (mot 16,4 GB i standard format)

- 4B – 0,86 GB (mot ~8 GB)

- 1,7B – 0,37 GB (mot ~3,4 GB)

Til sammenligning: Ternary Bonsai 8B scorer 75,5 i

gjennomsnitt på tvers av standardtester, og ligger kun

bak Qwen3 8B – som krever 16 GB RAM.

Ytelse i praksis

På M4 Pro kjører 8B-modellen 82 tokens per sekund –

omtrent 5x raskere enn en fullpresisjon 8B-modell.

På iPhone 17 Pro Max er hastigheten 27 tokens per sekund.

Energiforbruket er tilsvarende lavt: 0,105 mWh per token

på M4 Pro, mot vesentlig høyere forbruk for fullpreisionsmodeller.

Gratis og åpen

Alle tre modellene er tilgjengelige under Apache 2.0-lisens.

De kjører nativt på Apple-enheter via MLX, og CUDA/Vulkan-støtte

for Windows og Linux er på vei via en fork av llama.cpp.

PrismML ble grunnlagt av forskere fra Caltech og er støttet

av Khosla Ventures og Google.

Hva betyr dette?

Kraftig AI trenger ikke lenger kraftig maskinvare.

Ternary Bonsai er et konkret eksempel på at retningen

mot lokal, privat og energieffektiv AI ikke handler

om å ofre ytelse – men om å finne smartere måter å

pakke intelligens på.

Ressurser

- PrismML – offisiell side og whitepaper

- Hugging Face – Ternary Bonsai –

last ned modellene - Apache 2.0 Lisens –

vilkår for bruk